OpenClaw 使用笔记

介绍

详见飞书文档 OpenClaw笔记

原理

详见飞书文档 OpenClaw工作原理

Sub Agent 设计模式

【2026-5-9】subagent 的常用 4 种编排模式

主 agent 之外起 subagent 是搭复杂 AI 系统的常用做法。

按主 agent 对子 agent 生命周期的控制力从弱到强,4 种模式正在成形。

- Pattern 1

Inline Tool工具模式。subagent 当成普通 tool 调一次拿结果。call_agent 一个工具就够了。- Sync 模式 tool 阻塞返回结果,Async 模式立即返回 ID 结果稍后注入。

- 多数 subagent 用例从这里开始也停在这里 — research 查找、code review、文件分析、test 生成都能搞定。

- 局限:没法发 follow-up、没法查进度、没法提前 cancel。

- 任何支持 tool use 的模型都能跑,包括小模型。

- Pattern 2

Fan-Out。spawn_agent 立即返 ID,wait_agent 阻塞收集。模型自己决定何时 wait。好模型在 spawn 后做自己的活到节点再 wait,差模型 spawn 后立刻 wait 等于 Pattern 1 没拿到并发优势。- 适合多个独立任务可以并发跑,主 agent 不需要中间结果就能开下一个。仍然 fire-and-forget 没法中途纠偏。

- Pattern 3

Agent Pool。subagent 持久存在保留对话历史。主 agent 通过 spawn / send_message / wait / list / kill 五个工具协调。多回合对话,主 agent 在专家之间路由信息。适合多步工作流,agent 之间需要协作。局限是主 agent 要追踪多个 agent 状态,前沿模型勉强能管 2 至 4 个,更多就跟丢。 - Pattern 4

Teams。agent 之间直接对话,每个成员都有 cross-agent send_message。主 agent 搭好团队后退后只等汇报。适合大任务,协调逻辑超出单个 agent 能 step-by-step 管理。局限严重 — 每个 agent 都需要前沿级模型,还要解决循环检测、冲突解决、shutdown 协调、调试链追踪等基础设施挑战。

工程纪律:从 Pattern 1 起步。多数任务不需要复杂编排。只有真正需要并行 / 多步协作 / 复杂团队协调才往上走。模式越高,模型门槛越严,调试越痛。用便宜模型搭 Pattern 4 是最常见的失败方式。

应用

详见飞书文档 OpenClaw笔记

进化

基于 OpenClaw 改进论文

- 【2026-3-10】普林斯顿 OpenClaw-RL 实时回收利用这两类被浪费的信号,构建从任何交互流中持续学习的统一系统。

- 【2026-3-17】CMU+伯克利 推出持续元学习框架MetaClaw,联合维护基础 LLM 策略和不断演变的、包含可重用行为指令的技能库,实现 agent 自我进化

【2026-3-10】普林斯顿 OpenClaw-RL

解决什么问题?

现有 agent 强化学习系统大多依赖于预先收集的批量数据或最终结果奖励,忽视了真实交互中实时产生的、富含信息量的过程信号。

- 评价性信号:隐式地评价前一个动作的好坏。用户再次提问可能意味着不满意,通过的测试意味着成功,错误堆栈则意味着失败。这构成了一个天然的过程奖励,无需额外的人工标注。

- 指导性信号:指明动作应如何改进。用户说“你应该先检查文件”,不仅说明回答错了,更具体指出了改进方向。详细的软件错误追踪也常常暗示了具体的修正路径。

就像老师只根据期末考试成绩来评判学生,却完全忽略了日常作业、课堂提问和即时反馈的价值。

普林斯顿大学新研究——OpenClaw-RL,终结这种“数据浪费”,让AI智能体能够简单地通过被使用来学习与进化。无论是个人对话助手,还是执行终端、GUI、软件工程或工具调用任务的通用智能体,都能在同一套框架下,从实时交互信号中持续学习。

OpenClaw-RL 核心创新: 实时回收利用这两类被浪费的信号,构建从任何交互流中持续学习的统一系统。

2026-3-10】普林斯顿 OpenClaw-RL

- OpenClaw-RL: Train Any Agent Simply by Talking

- 代码 OpenClaw-RL

- 解读 OpenClaw-RL:让智能体在对话中自我进化,实现统一的智能体强化学习框架

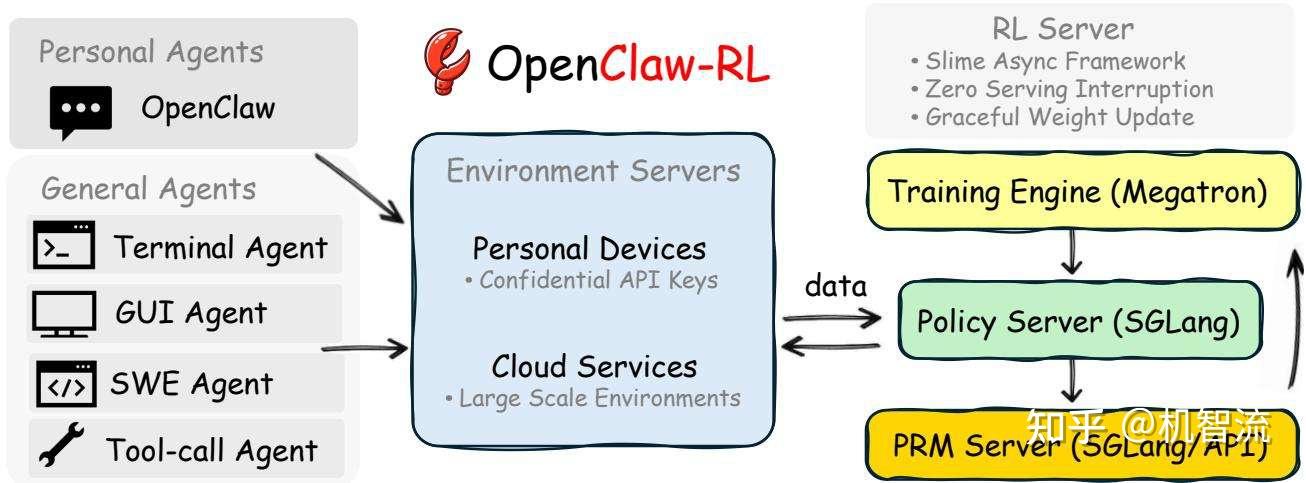

OpenClaw-RL 框架: 完全解耦的异步架构。

- 下一状态信号是通用的,同一个策略可以同时从所有类型的信号中学习。

- 个人对话、终端执行、GUI交互、软件工程任务和工具调用轨迹,不再是各自独立的训练问题,而是可以用于在同一循环中训练同一策略的交互流。

完全解耦的异步架构

- 策略服务、环境交互、PRM(过程奖励模型)评判和策略训练作为四个独立的循环运行,彼此之间没有阻塞依赖。

- 模型在服务下一个用户请求的同时,PRM正在评判上一个响应,训练器则在应用梯度更新——三者互不等待。

- 正是这种设计,使得从实时、异构的交互流中进行连续训练变得可行。

OpenClaw-RL基础设施概览。

- 交互流来自两种智能体:部署在个人设备上的个人智能体(对话式、单用户),以及托管在云服务上的通用智能体(终端、GUI、SWE和工具调用智能体)。

- 收集的样本流入基于异步slime框架构建的RL服务器,该服务器由四个解耦的组件构成,支持优雅的权重更新,并能与任何智能体框架协同训练。

OpenClaw-RL 标志着智能体训练范式的重要转变。不再将训练和部署视为两个割裂的阶段,而是构建了实时交互中持续学习、自我演进的闭环系统。

【2026-3-17】CMU+伯克利 MetaClaw

解决什么问题?

- 现有agent部署后,保持静态,能力逐步过时

OpenClaw 平台上,单个智能体连接 20 多个消息渠道并处理多样化、不断变化的工作负载,现有方法

- 要么存储原始轨迹而不提炼可迁移的行为知识

- 要么维护与权重优化脱节的静态技能库

- 要么在重新训练期间导致服务中断。

【2026-3-17】CMU+伯克利

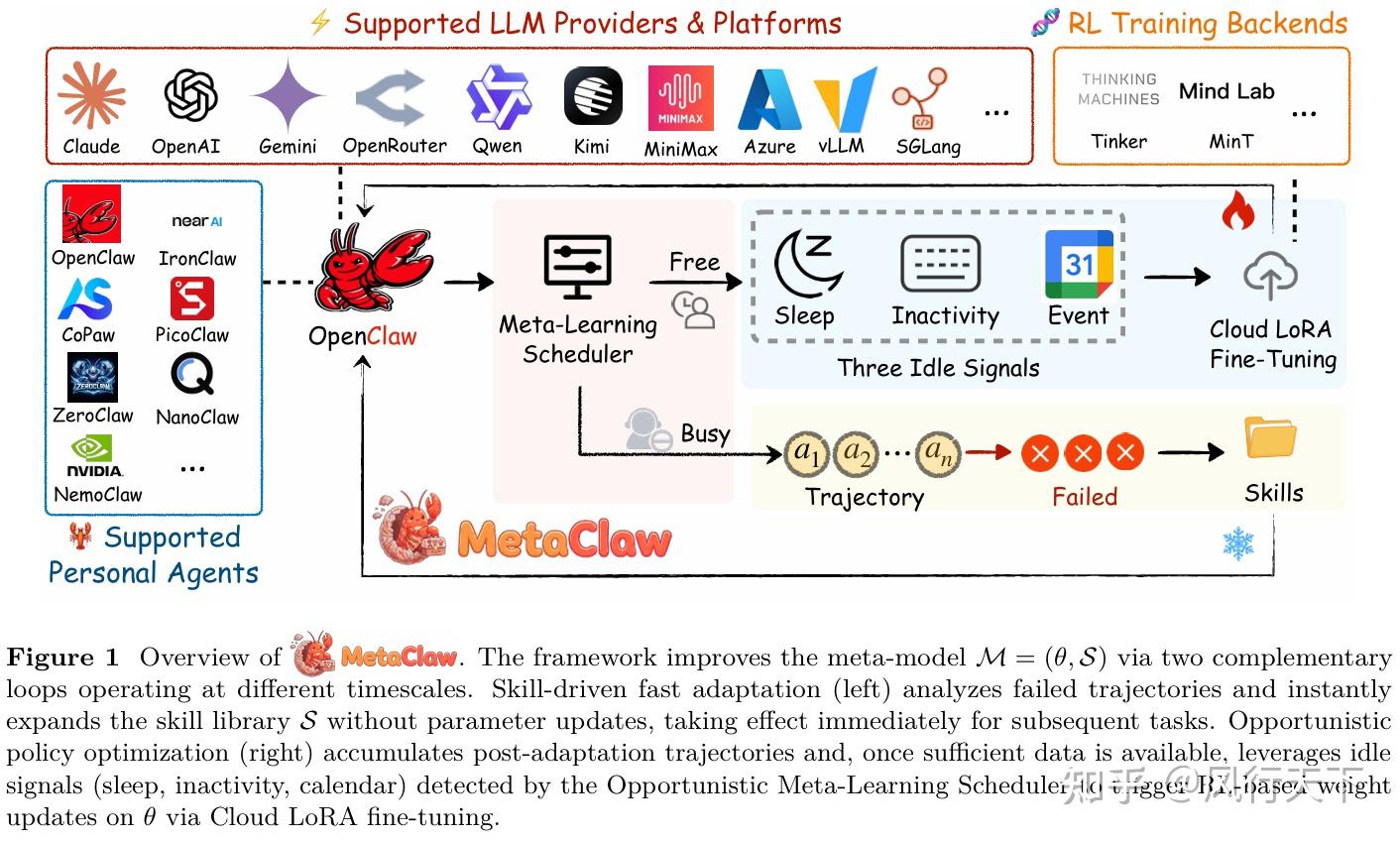

MetaClaw 持续元学习框架,联合维护基础 LLM 策略和不断演变的、包含可重用行为指令的技能库,并通过两种互补的机制对两者进行改进。

- 技能驱动的快速适应分析失败轨迹,并通过一个 LLM 进化器合成新技能,这些技能立即生效,实现零服务中断。

- 机会性策略优化通过机会性元学习调度器(OMLS)在用户非活动窗口期间被触发,利用带过程奖励模型(PRM)的强化学习(RL)在云端执行基于梯度的 LoRA 微调权重更新。

两种机制相互促进:更好的策略能为技能合成提供更多信息丰富的失败案例,而更丰富的技能则能为策略优化提供更高回报的轨迹。

MetaClaw 基于代理架构构建,无需本地 GPU 即可扩展到生产规模的 LLM。

MetaClaw-Bench(934 个问题,44 个模拟工作日)和 AutoResearchClaw(23 阶段自主研究流水线)上的实验显示出一致的改进:仅技能驱动适应就将准确率相对提升了高达 32%;完整流水线将 Kimi-K2.5 的准确率从 21.4% 提升至 40.6%(对比 GPT-5.2 基线 41.1%),端到端任务完成率提升了 8.25 倍;并且仅技能注入就将 AutoResearchClaw 的综合鲁棒性提升了 18.3%。

同类框架

【2026-4-11】OpenClaw、Hermes、Superagent:Agent 时代的三条路线,该怎么选?

三条完全不同的路线

- OpenClaw:怎么让 AI 真正变成常驻个人助手。

- Hermes:怎么让 Agent 在更低成本下持续学习、越用越顺手。

- Superagent:当 Agent 真要进生产环境时,怎么别把公司数据和合规底线一起送走。

这不是简单的“三个框架谁更强”。而是 Agent 时代分叉:有人抢生态,有人抢效率,有人抢安全入口。

Agent 下半场面临的工程问题:

- 要不要 24 小时常驻

- 要不要跨平台接入

- 成本会不会失控

- 技能怎么沉淀

- 上下文怎么管理

- 权限怎么收口

- 安全事故出了谁负责

大家争夺的不是“谁更像一个聪明聊天机器人”,而是:谁能成为下一代 AI 工作流里的基础设施。

| 产品 | 导向 | 特点 | 适合谁 |

|---|---|---|---|

| OpenClaw | 生态优先 | 通用助手中控层; 生态厚/产品强/扩展强; 但太重/成本高/上下文管理厚/安全问题 |

尽快跑起来 |

| Hermes | 学习效率优先 | 会进化的轻量agent | 重视效率和积累 |

| Superagent | 安全治理优先 | 安全与治理闸门 | 生产环境 |

更多比较

Claude Code / OpenClaw / Hermes Agent 对比表

| 维度 | Claude Code | OpenClaw | Hermes Agent |

|---|---|---|---|

| 核心隐喻 | 工匠 (Craftsman) | 宠物 (Pet) | 管家 (Manager) |

| 交互模式 | 实时结对编程 | 配置即行为 | 自主后台运行,跨平台汇报 |

| 擅长场景 | 写代码、重构、Debug | 个人助理、轻量任务 | 长周期任务、巡检、日报 |

| 模型支持 | 仅 Claude | 多模型 | 200+ 模型(含 Claude) |

| 部署形态 | 本地终端绑定 | 特定生态绑定 | Anywhere(VPS/Serverless) |

Hermes

【2026-4-15】资讯 Hermes Agent被实锤架构级抄袭中国团队 EvoMap 的开源项目 Evolver:10步主循环一一对应、12组术语系统性替换、7份材料零归属。

- EvoMap 开源 Evolver 36天后,融资过亿的硅谷团队 Nous Research“重新发明”了整套自进化架构。

- 被锤后官方回应仅一句“Delete your account”,随后删帖拉黑。

Hermes 介绍

- 教程:第三方教程 Hermes Agent

Hermes 如何发音?

两种读法,Hermès(法国品牌,带重音)与 Hermes(希腊神名,无重音)发音完全不同,核心区别:法语 h 不发音,英语 h 发音。

| 类型 | 音标 | 近似读音 | 注意 |

|---|---|---|---|

| 国际音标 | /ɛʁˈmɛs/ | 艾尔 - 梅斯 | H不发音 |

| 赫尔墨斯希腊神名:赫尔墨斯 | /ˈhɝːmiːz/ | 赫-儿-米兹 | H清晰发音, s浊化为z |

总结

- ❌ 误读:“赫尔 - 梅斯”(混英法)

- ✅ 品牌:“爱马仕” ≈ 艾尔梅斯

- ✅ 神话:“赫尔墨斯” ≈ 赫米兹

GUI

官方 Web UI

第三方 Web UI

- 【2026-4-11】Hermes-HUDUI 开源项目,为本地AI代理 Hermes 提供了可视化控制面板,解决了”黑盒”问题,可实时查看AI记忆、当前目标与会话历史。

- hermes-webui

(1) Hermes Web-UI

git clone https://github.com/nesquena/hermes-webui.git hermes-webui

cd hermes-webui

python3 bootstrap.py

# 或

./start.sh

(2) hermes-hudui

项目地址:hermes-hudui

安装方法

git clone https://github.com/joeynyc/hermes-hudui.git

cd hermes-hudui

./install.sh

hermes-hudui # 不一定管用

source venv/bin/activate && hermes-hudui

打开地址 ocalhost:3001

架构

Hermes Agent 核心架构

架构拆解:三层记忆 + 五层防线

Hermes 核心创新概括:像人类一样记忆,像银行一样安全。

- 三层记忆架构:越用越懂你的秘密

- 五层安全防线:比 OpenClaw 更谨慎

1. 三层记忆架构:越用越懂你的秘密

传统 AI 助手最大的痛点是”失忆”——每次对话从零开始。Hermes 通过三层记忆系统解决这个问题:

Agent 三层记忆架构表

| 层级 | 名称 | 存储内容 | 实际例子 |

|---|---|---|---|

| 第一层 | 持久事实层 | 用户偏好、项目习惯、长期工作上下文 | “你习惯用 4 空格缩进,讨厌驼峰命名” |

| 第二层 | 程序性记忆层 | Skill(技能)及对应的优化迭代历史 | “写周报时先读取 Git 提交记录,再自动生成内容总结” |

| 第三层 | 历史搜索层 | 全量对话上下文、完整任务执行流水记录 | “上周三你让查询的竞品数据在这里” |

- 第一层(长期静态记忆):几乎永久保存,不随单次对话过期,塑造 Agent 固定工作风格与个人习惯

- 第二层(流程技能记忆):固化标准化工作流程,持续迭代优化任务执行步骤,形成可复用自动化能力

- 第三层(时序上下文记忆):短期对话回溯,支持历史问答溯源、跨时间任务关联查询

为什么分层?

- 想象一下:如果你每次聊天都要从幼儿园回忆开始,效率有多低。Hermes 默认只加载第一层(几百字摘要),需要时才检索深层记忆,既省 Token 又防幻觉。

Skill 自生长机制:完成任务后,Hermes 会自动复盘——”这次哪里做得好?哪里可以优化?”然后将经验固化为新的 Skill(一个 Markdown 文件)。下次遇到类似任务,直接调用 Skill,无需重新推理。

实际效果:第一次写周报需要 10 分钟,第二次可能只需 30 秒。

2. 五层安全防线:比 OpenClaw 更谨慎

Hermes 在安全性上做了大量工作,特别适合企业场景

AI Agent 安全五层防护体系

| 防线 | 机制 | 示例 |

|---|---|---|

| 用户授权 | 敏感高危操作强制要求用户手动确认 | 删除文件前弹窗二次确认 |

| 危险命令审批 | rm -rf 等高风险系统指令拦截+二次校验 |

严防误删线上生产环境数据 |

| 容器隔离 | Agent 任务全程在独立沙箱容器内运行 | 异常代码崩溃、恶意行为不会影响宿主主机 |

| 上下文扫描 | 前置检测对话与指令里的注入类风险 | 自动识别拦截 SQL 注入、系统命令注入攻击 |

| 权限最小化 | 默认只读权限,所有写入/修改操作必须显式授权 | 从根源杜绝越权访问、非法篡改文件 |

问题

【2026-5-9】Hermes Agent 被忽视的 4 个坑,DTClaw 如何填平?

4 个关键问题几乎没人提:

- 部署体验简化了,认知鸿沟还在

- 自进化是最大亮点,也藏着最大隐患

- 记忆设计精巧,但适用面有限

- 安全纵深做得扎实,但规则总有尽头

蚂蚁数科 DTClaw 的实践

| 坑 | DTClaw 填平方式 |

|---|---|

| 认知门槛高 | 专业虾模板 + 密态技能,开箱即专业 |

| 自进化不可控 | 模型提案 + 确定性决策 + 回滚机制 |

| 记忆场景单一 | 插件化记忆后端,场景自选策略 |

| 静态规则有尽头 | CARLI 五维模型,允许犯错但损害可控 |

DTClaw 不是另一个 Hermes,而是更成熟的“数字合伙人”

DTClaw 还具备:

- PinchBench 87.93% 综合得分,超越官方基准 7%~22%

- 上下文优化插件:智能压缩冗余,节省 50% Token

- 存算分离架构:热切换实例无中断,零数据丢失

- 支付宝 AI 付:让 Agent 从“能执行”进化为“能交易”

Evolver

EvoMap 十几人的中国年轻团队从零搭建了一整套AI Agent自进化引擎 Evolver,给AI智能体装上「基因系统」,让能力可以像生物基因一样遗传、变异、进化。

EvoMap 开源 Evolver 36天后,融资过亿的硅谷团队 Nous Research“重新发明”了整套自进化架构。

- GitHub Evolver

支付宝打赏

支付宝打赏  微信打赏

微信打赏